8月31日,上海人工智能实验室(上海AI实验室)宣布开源发布多模态大模型书生·万象InternVL3.5。该模型通过创新的级联式强化学习(Cascade RL)、动态视觉分辨率路由与解耦部署架构,实现了推理能力、部署效率与通用能力的全面升级。InternVL3.5开源了从1B到241B各尺寸参数的全量级版本,刷新了开源模型性能标杆,在多种任务上达到领先水平。

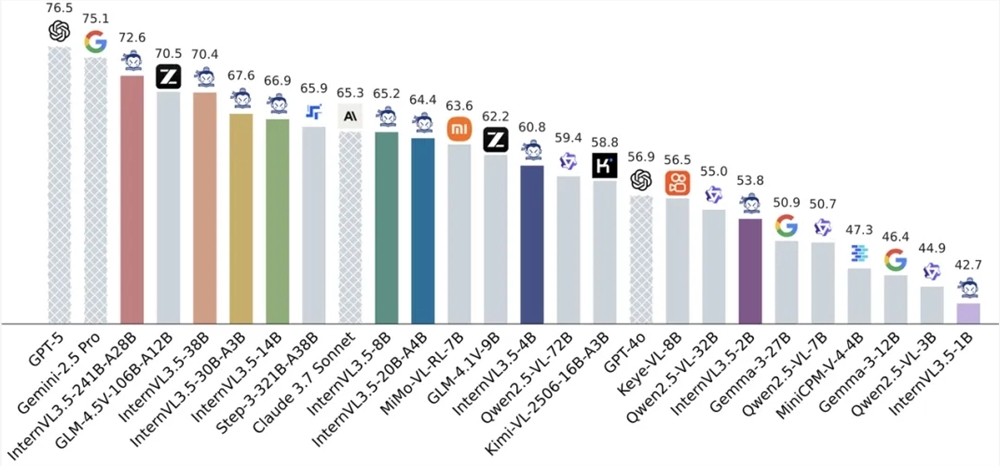

InternVL3.5的旗舰模型InternVL3.5-241B-A28B在多学科推理基准MMMU中获得开源模型最高分77.7分,多模态通用感知基准MMStar和OCRBench分别取得77.9分和90.7分,超越GPT-5(75.7分/80.7分)。文本推理基准AIME25和MMLU-Pro分别达到75.6和81.3分,全面领先现有开源多模态大模型。依托级联式强化学习框架,全系列模型推理性能相比上一代平均提升16.0分。其中,InternVL3.5-241B-A28B综合推理性能达到66.9分,超越上一代模型的54.6分以及Claude-3.7-Sonnet的53.9分,在数学推理、逻辑推理等复杂任务中表现突出。

借助创新的视觉分辨率路由(ViR)与解耦部署框架(DvD),38B模型在896分辨率下的响应速度大幅提升,单次推理延迟由369ms缩短至91ms(提升约4倍)。与此同时,轻量化的InternVL3.5-Flash在将视觉序列长度减少50%的情况下,仍能保持接近100%的性能水平。

InternVL3.5还加强了GUI智能体、具身智能体、SVG图形理解与生成等智能体核心能力,在ScreenSpot GUI定位(92.9分)、VSI-Bench空间推理(69.5分)、SGP-Bench矢量图理解(70.6分)等任务中超越主流开源模型。

InternVL3.5提供10亿至2410亿参数共九种尺寸模型,覆盖不同资源需求场景,包含稠密模型和专家混合模型(MoE),是首个支持GPT-OSS语言模型基座的开源多模态大模型。官方提供了使用`transformers`运行`InternVL3.5-8B`的示例代码,模型最多可以部署在单张A100GPU上,而38B模型需要2张A100GPU,235B模型则需要8张A100GPU。

ms-swift已经支持对InternVL3.5系列模型进行训练。ms-swift是魔搭社区官方提供的大模型与多模态大模型训练部署框架。用户可以将数据准备成特定格式进行自定义数据集微调。训练完成后,可以使用相应命令进行推理,并将模型推送到ModelScope。

InternVL3.5的发布标志着多模态大模型技术的又一重要进展,为研究人员和开发者提供了强大的工具,推动了多模态人工智能的发展。

声明:本文来自AI新闻资讯,版权归作者所有。文章内容仅代表作者独立观点,不代表数字化转型网立场,转载目的在于传递更多信息。如有侵权,请联系我们。数字化转型网www.szhzxw.cn

本文由数字化转型网(www.szhzxw.cn)转载而成,来源于AI新闻资讯;编辑/翻译:数字化转型网(Professionalism Achieves Leadership 专业造就领导者)萍水