数字化转型网人工智能研习社关注人工智能从技术到落地的全方面,包含机器学习算法、深度学习架构、自然语言处理(NLP)技术、计算机视觉技术、AI+医疗健康、AI+交通出行、AI+金融、AI+制造、AI+消费品、AI+互联网、数据隐私和安全、算法公平性、产业生态建设、政策法规制定与完善等。

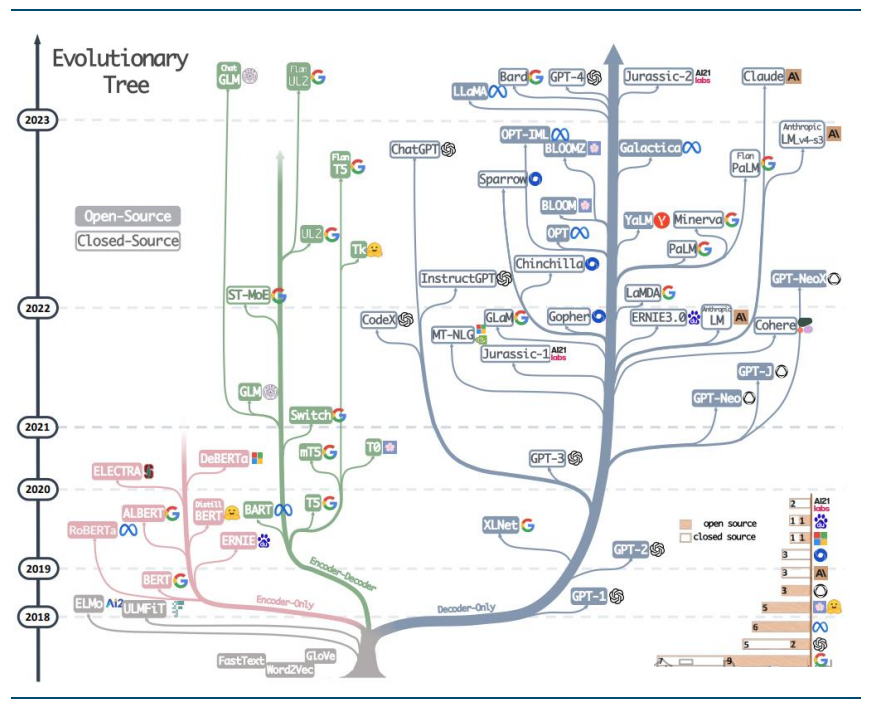

在深度学习技术迅猛发展的推动下,AI大模型已然成为人工智能领域备受瞩目的焦点,吸引了学术界和产业界的广泛关注。这些具备庞大参数规模和卓越学习能力的神经网络模型,如BERT、GPT等,在自然语言处理、计算机视觉等多个领域取得了显著成效,有力地推动了相关领域的技术进步。本文将系统梳理AI大模型的发展历程,深入剖析其技术原理,并展望其未来应用前景,旨在为读者提供全面且深入的理解,引发对AI大模型的深入思考。

一、AI大模型的发展背景与成果

发展背景

AI大模型起源于深度学习技术的不断演进。深度学习通过构建多层神经网络模拟人类大脑工作原理,实现对复杂数据的深入学习与理解。在过去几十年中,深度学习技术取得了诸多重要突破,如多层感知机(MLP)、卷积神经网络(CNN)、循环神经网络(RNN)、深度残差网络(ResNet)以及Transformer模型等。随着数据量的急剧增长和计算能力的大幅提升,研究人员致力于构建更大规模、更复杂的神经网络模型,以增强模型的表征和泛化能力。BERT、GPT、T5等大型模型的出现,标志着AI大模型时代的来临,推动了人工智能及其子领域的快速发展。然而,AI大模型也面临着训练成本高昂、计算难度大、泛化能力有限等挑战,亟待深入研究与优化。数字化转型网www.szhzxw.cn

研究成果与应用案例

1. 自然语言处理(NLP)

BERT基于Transformer架构,通过双向编码器捕获文本双向上下文信息,在多个NLP任务中取得领先成果。

GPT系列是生成式模型,能生成连贯自然语言文本,在文本生成和对话生成任务中表现优异。

T5通过统一输入输出形式,实现对多种NLP任务的统一处理,拓展了应用边界。

2. 计算机视觉

ViT将Transformer架构引入计算机视觉领域,在图像分类、目标检测等任务中表现出色。基于Transformer的其他模型,如DETR等,也推动了该领域技术创新。数字化转型网www.szhzxw.cn

AI大模型的理论基础

基本原理与核心技术

1. Transformer架构:由编码器和解码器组成,依赖自注意力机制实现序列到序列转换,为AI大模型奠定基础。数字化转型网www.szhzxw.cn

2. 自注意力机制:核心组件,可在输入序列所有位置进行注意力计算,捕捉长距离依赖,增强对复杂序列数据的处理能力。

3. 预训练与微调:结合预训练和微调策略,利用大规模无标注数据预训练,再针对特定任务微调,提升泛化和适应能力。

4. 多头注意力:允许模型在多个子空间并行学习不同特征表示,增强表达和学习效率。

5. 残差连接与层归一化:残差连接确保信息有效传递,缓解梯度问题;层归一化加速训练收敛,提升稳定性和泛化能力。数字化转型网www.szhzxw.cn

6. 优化与正则化技术:采用多种优化算法(如SGD、Adam等)和正则化技术(如L1、L2正则化、Dropout等)提升性能,减少过拟合风险。

神经网络训练与优化

1. 损失函数:衡量模型预测与实际标签差异,通过最小化损失函数调整模型参数,常见的有均方误差、交叉熵损失等。

2. 反向传播算法:计算损失函数关于模型参数的梯度,利用链式法则反向传播误差,更新模型参数。

3. 优化算法:如随机梯度下降、动量法、AdaGrad、RMSProp、Adam等,改进梯度下降,提升收敛速度、稳定性和泛化能力。

4. 激活函数:引入非线性变换,增强模型表达能力,常见的有Sigmoid、ReLU、Tanh等,选择合适的激活函数对模型性能至关重要。数字化转型网www.szhzxw.cn

二、AI大模型的技术方法

训练大型模型的技术

1. 分布式训练:将训练任务分散到多个计算节点,协同加速训练,应对大规模数据和模型的计算存储挑战。

2. 混合精度训练:在不同计算阶段采用不同数值精度,减少内存占用和计算量,保持训练速度和精度。

3. 数据并行与模型并行:数据并行处理不同数据批次,模型并行聚焦模型各部分并行训练,可灵活结合。

4. 异步训练:分布式环境中计算节点异步训练,提高效率,但需处理收敛速度和稳定性问题。

5. 模型蒸馏:将大型模型知识转移到小型模型,压缩知识,减少存储和计算负担。

6. 预训练与微调:预训练用大规模无标注数据初始化模型,微调使其适应特定任务。

7. 动态学习率调整:根据训练过程中模型性能变化动态调整学习率,优化收敛速度和泛化能力。

大型模型的优化与压缩技术

1. 模型剪枝:移除冗余参数和连接,减小模型规模和计算量,保持性能。

2. 量化:将模型参数和激活值转换为低精度或定点数表示,降低存储需求和计算复杂度,提升硬件运行效率。数字化转型网www.szhzxw.cn

3. 低秩近似:对模型参数矩阵进行低秩分解,减少参数数量和计算量,保持主要性能特征。

4. 知识蒸馏(再次提及):将大型模型知识转移到小型模型,实现有效压缩,保持较高性能。

三、AI大模型的应用场景

不同领域的应用案例

1. 自然语言处理(NLP)

语言理解:借助BERT、GPT等模型,实现情感分析、命名实体识别、文本分类等任务高效执行。

语言生成:生成文章、对话系统等文本内容。数字化转型网www.szhzxw.cn

机器翻译:采用Transformer架构实现高精度多语言翻译。

2. 计算机视觉(Computer Vision)

图像分类与目标检测:利用CNN等结构的AI大模型取得显著成效。

图像生成:借助GAN和VAE等模型实现图像超分辨率、风格迁移等高级功能。

3. 自动驾驶与智能交通

自动驾驶:AI大模型在处理传感器数据、环境感知、路径规划和行为预测等方面发挥关键作用。

智能交通管理:运用RNN等模型实现交通流预测、拥堵管理等任务高效执行。

4. 医疗与生物信息学

医学影像分析:在医学影像数据分析中展现强大能力,助力疾病诊断和病灶检测。

药物设计与发现:用于药物筛选和分子对接,加速研发进程。数字化转型网www.szhzxw.cn

5. 金融与风控

信用评分:通过深度学习模型分析客户数据,提供信用评分和风险管理依据。

欺诈检测:借助逻辑回归等模型提升交易数据分析能力,防范欺诈风险。

6. 教育与辅助学习

个性化教育:挖掘学生数据,规划个性化教育方案和学习路径。数字化转型网www.szhzxw.cn

智能辅导:通过聊天机器人实现学习过程实时监控和高效辅导。

应用中的优势和局限性

1. 优势

强大表征能力:深入理解复杂数据模式和特征,在各类任务中表现出色。

泛化能力强:预训练学习通用特征表示,适应不同领域和任务。

多模态融合:支持多种数据处理与融合,拓展应用场景。数字化转型网www.szhzxw.cn

自动化特征提取:自动学习数据特征,减少人工工作量,提高效率和准确性。

持续迭代优化:可通过大规模数据迭代优化,提升性能和精度。

2. 局限性

资源需求大:训练和推理对计算资源和存储空间要求高,增加硬件成本和部署难度。

可解释性差:模型复杂,内部结构和决策过程难以理解,限制应用范围。

数据隐私与安全风险:依赖大量数据,可能导致隐私泄露和安全风险。数字化转型网www.szhzxw.cn

过拟合与泛化不足:小样本场景下可能过拟合,泛化能力不足,需调优改进。

环境依赖性:性能受环境、数据分布和任务特性影响,需适应性调整优化。

AI大模型在人工智能领域具有重要意义,但也面临诸多挑战。通过深入理解其技术原理和应用特点,我们能更好地发挥其优势,应对挑战,推动其在更多领域的创新应用,为社会发展创造更大价值。同时,应关注其局限性,积极探索解决方案,实现可持续发展。

声明:本文来自网络,版权归作者所有。文章内容仅代表作者独立观点,不代表数字化转型网立场,转载目的在于传递更多信息。如有侵权,请联系我们。数字化转型网www.szhzxw.cn

数字化转型网人工智能研习社包含哪些内容

数字化转型网人工智能研习社关注人工智能从技术到落地的全方面,包含机器学习算法、深度学习架构、自然语言处理(NLP)技术、计算机视觉技术、AI+医疗健康、AI+交通出行、AI+金融、AI+制造、AI+消费品、AI+互联网、数据隐私和安全、算法公平性、产业生态建设、政策法规制定与完善等。

本文由数字化转型网(www.szhzxw.cn)转载而成,来源于 产业经纬;编辑/翻译:数字化转型网Jack。