如果你曾经尝试过硬啃 AI,你一定在某个深夜破防过,心里咆哮着: “这到底是在搞什么鬼?” 术语多如牛毛,工具满天飞,网上每个人说话都像在显摆,仿佛这些东西理所应当就该懂。学习 AI 确实会让人感到窒息,尤其是当你不在这个圈子里混的时候,那感觉简直就像在学一门外星语言。但经过这段时间的死磕,我悟到了一个真理:AI 并没有那么高不可攀。只要你摸透了最底层的逻辑,尤其是大语言模型(LLM)的运作方式和现代工具的构建思路,你会发现,所有的迷雾瞬间就散了。

今天,我要用最接地气的方式,为你暴力拆解 20 个最核心的 AI 概念。没有听不懂的黑话,没有故弄玄虚的公式,只有最直白的解释和最直观的例子,咱们现在就开始。数智化转型网www.szhzxw.cn

一、地基篇

1、神经网络 (Neural Networks)

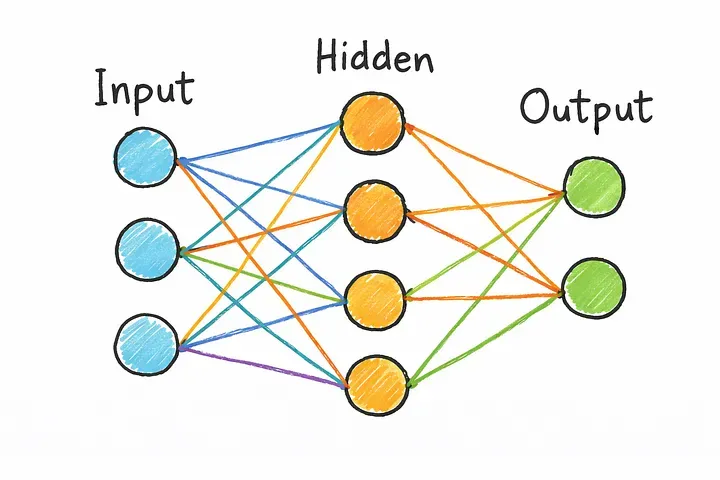

说白了,神经网络就是一个由微小单元(神经元)连接而成的多层系统。你可以把它想象成一条加工流水线。 数据从输入层流进去,经过好几层隐藏层的反复揉捏,最后从输出层吐出一个预测结果。 那里面到底发生了什么? 其实就是步步精进的过程。 同样一份输入被反复处理,每经过一层,模型对它的理解就深一分。 比如在图像模型里:第一层可能只认识边缘或纹理;中间层开始看出形状或图案;深层则能识别出具体的物体。数智化转型网www.szhzxw.cn

这就是从“像素 → 形状 → 意义”的升华。 这里有个核心细节:神经元之间的每个连接都有一个权重 (Weight)。 你可以把权重看成是“重要性分数”,它决定了一个神经元对另一个的影响力。所谓训练模型,本质上就是不停地调整这些权重,直到模型能给出准确的结果。现在的模型疯狂到什么程度? 那些大模型不只有几个权重,它们拥有数千亿个权重,没日没夜地把原始数据转化成人类能听懂的话。

2、迁移学习 (Transfer Learning)

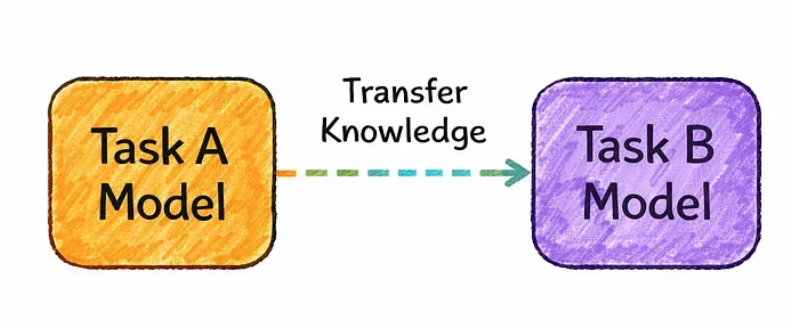

从零开始训练一个神经网络听起来很酷,但那真的是在烧钱。你需要海量的数据、恐怖的算力,还有无穷无尽的时间。 这时候,迁移学习救了我们的命。我们不再从零起步,而是拿一个已经在广义任务上练成的“大神级”模型,然后把它微调到我们的具体场景里。这就是技能迁移。

就像你如果已经学会了骑自行车,那学摩托车是不是轻而易举?因为你不需要从平衡感学起,你只是在应用已有的知识。迁移学习也是这个逻辑。预训练模型已经掌握了数据的通用模式,所以当你针对特定任务去训练它时,它学得极快,而且耗费极低。这就是现代 AI 的生存之道: 大厂负责练“通才”模型,我们开发者负责把它们变成各行各业的“专才”。数智化转型网www.szhzxw.cn

二、Transformer 全家桶

1、 分词 (Tokenization)

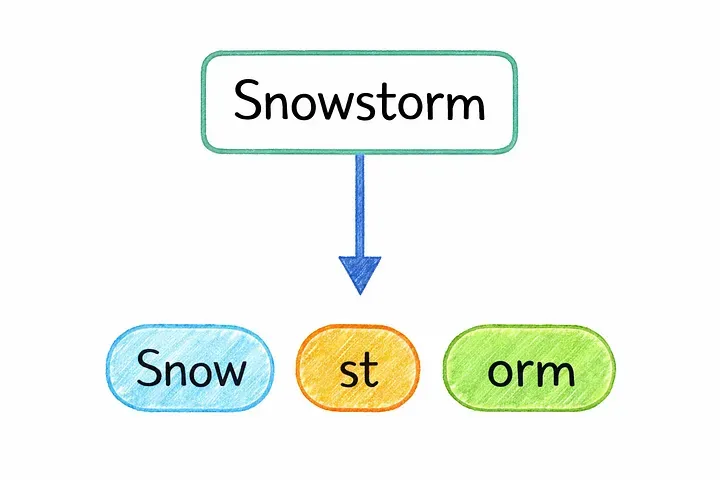

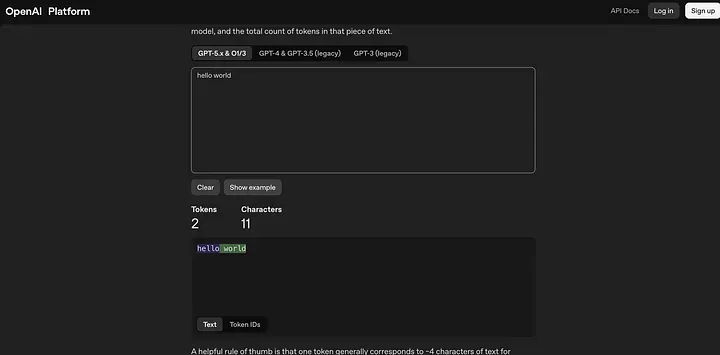

在模型理解文字之前,它必须先给文字“分家”,这就是分词。 模型不读句子,它读的是一个个微小的单位——Token。这些 Token 就是 AI 世界里的字母表。但是,Token 并不等于单词,有时候它是一个完整的词,有时候只是词的一部分。比如 “playing” 可能会被拆成 “play” 和 “ing”。你可能会问:为什么要搞这么麻烦?数智化转型网www.szhzxw.cn

因为语言这东西太乱了,新词层出不穷,还有拼写错误和方言。 如果模型要记住每个单词,它的词汇表会大到爆炸。分词通过使用固定的“乐高积木”解决了这个问题。哪怕遇到从未见过的词,模型也能通过拆解熟悉的零件来猜出意思。 所以,AI 并不是像人类那样读书,它是在读零件,然后拼凑意义。

2、 嵌入 (Embeddings)数智化转型网www.szhzxw.cn

文字拆成 Token 后,下一步就是让模型能处理它。 这时候,嵌入登场了。每个 Token 都会被转化为一个向量,其实就是一串代表意义的数字。你可以把它想象成一张意义地图。每个词在多维空间里都有一个坐标。意思相近的词(如“医生”和“护士”)会住得很近,而“医生”和“大山”则会离得十万八千里。 虽然这个空间有成百上千个维度,但它精准捕捉了逻辑。 你会发现,“演员”和“女演员”的关系,竟然完美对应了“王子”和“公主”的关系。模型不理解定义,它只理解几何:通过距离和方向,它算出了世界的含义。

3、注意力机制 (Attention)

这才是真正拉开差距的技术。词的意思从来不是死的,它取决于上下文。 就拿 “Apple” 来说。在一个句子里,它是水果;在另一个句子里,它是那家卖 iPhone 的公司。模型怎么区分?光靠嵌入是不够的,因为它给每个 Token 的初始坐标是固定的。于是有了“注意力”。它让每个词在处理时,都能环顾四周,看看句子里哪些词跟自己最亲。比如在“她买了苹果公司的股票”里,模型会把注意力集中在“买”和“股票”上,瞬间明白这个 “Apple” 指的是公司。它不再是一个词一个词地读,而是全盘扫描,动态聚焦。 这种全局视野彻底解锁了现代 AI 的智商。

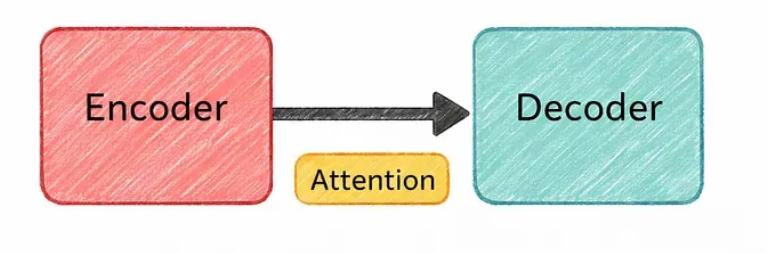

4、Transformer 架构

把分词、嵌入、注意力全捏在一起,就成了 Transformer。 它是 2017 年那篇神级论文《Attention Is All You Need》的结晶。它的核心理念暴力而优雅:别再按顺序读了,让注意力成为核心,一眼望尽所有信息。Transformer 就像是把多层注意力机制堆叠在一起。数智化转型网www.szhzxw.cn

- 浅层理解基础语法。

- 深层捕捉逻辑关系。

- 最深层处理复杂推理。

它最无敌的地方在于并行处理。老模型只能排队读,它能同步算。 这就是为什么 GPT、Claude、Gemini 全都跪倒在它的裙下。

三、大模型 (LLM) 进阶

1、大语言模型 (LLM)

说穿了,LLM 就是在一个天文数字级的文本库上练出来的 Transformer。它的训练目标简单到让人想笑:预测下一个 Token。就这样,但当这个简单的动作重复了万亿次后,奇迹发生了。它掌握了语法、逻辑甚至推理。这虽然只是概率上的模式识别,但由于规模大到了极致,它看起来就像拥有了灵魂。所谓的“大”,指的就是参数量。现在的模型动辄拥有数千亿个参数。 所以,当你和 ChatGPT 聊天时,你其实是在和一个通过“猜下一个词”而自通了人类文明的怪物在对话。数智化转型网www.szhzxw.cn

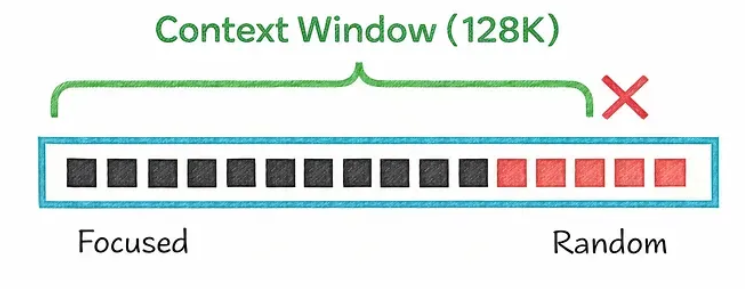

2、上下文窗口 (Context Window)

每个 AI 都有它的“瞬间记忆”极限,这就是上下文窗口。它决定了模型在一次对话中能塞进多少信息。 早期模型只能记几千个词,聊长了就会“断片儿”。 现在的模型窗口大到惊人,能一口气吞下一整本书。但别高兴太早。窗口越大,反应越慢,开销越高。而且还有个“迷失在中间 (Lost in the middle)”的问题:模型往往只记得开头和结尾,中间的信息容易被它当耳边风。

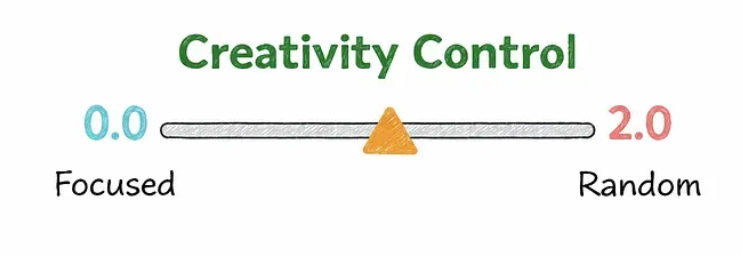

3、温度 (Temperature)

模型生成文本时,并不是死板地选概率最高的那个词,它会进行选择。温度决定了这种选择是“保守”还是“狂野”。数智化转型网www.szhzxw.cn

- 低温度: 稳如老狗。它只选最稳的词,适合写代码、写总结。

- 高温度: 脑洞大开。它会选一些冷门的路径,适合写小说、头脑风暴。

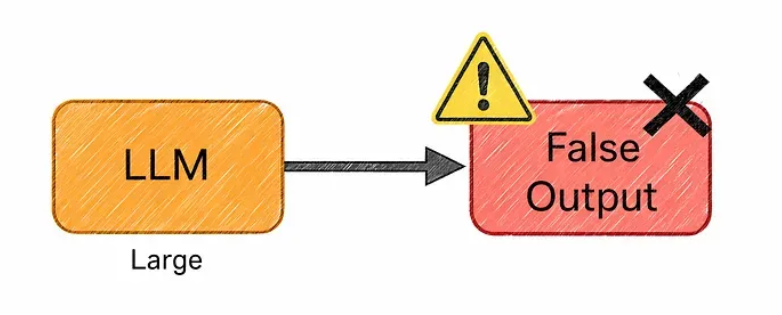

4、幻觉 (Hallucination)

这是每个 AI 用户的噩梦:它一本正经地胡说八道。它会自信地给你编造一个不存在的法律条文,或者推荐一个死活跑不通的接口。为什么?因为它的底层逻辑是“概率”,而不是“真理”。如果一个谎话在语法和逻辑上看起来非常顺滑,它就会毫不犹豫地把它吐出来。 所以,永远记得:AI 负责给方案,你负责当裁判。

四、训练与优化

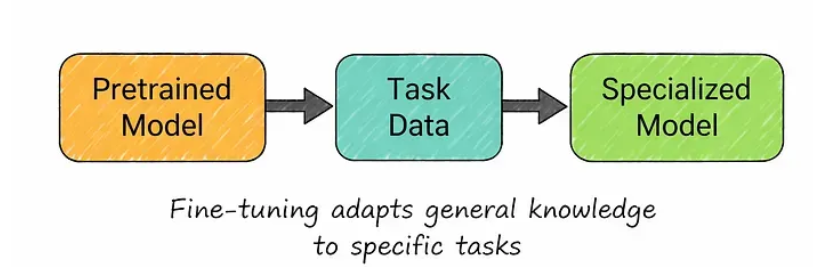

1、微调 (Fine-Tuning)

这是让“通才”变成“专才”的必经之路。预训练模型已经懂语言了,我们只需在特定的小数据集上再拉练它一下。比如,给它看海量的医疗合同,它就能变成“法律医疗助手”。但这依然是一项重资产操作,因为哪怕是微调,也往往需要更新庞大的内部参数,非常吃显存和算力。

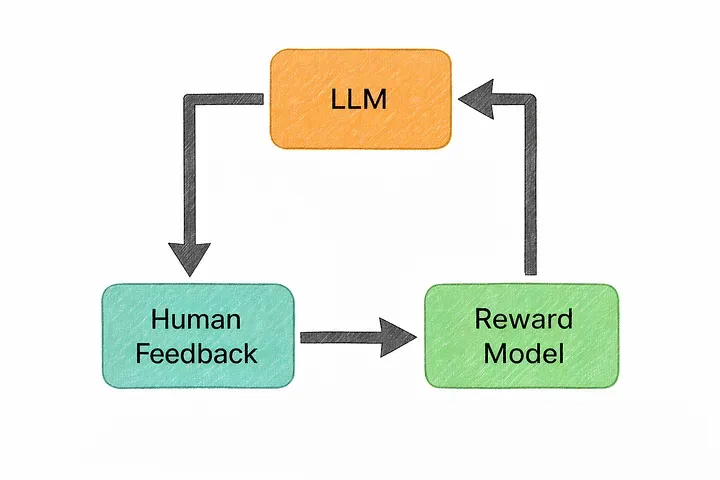

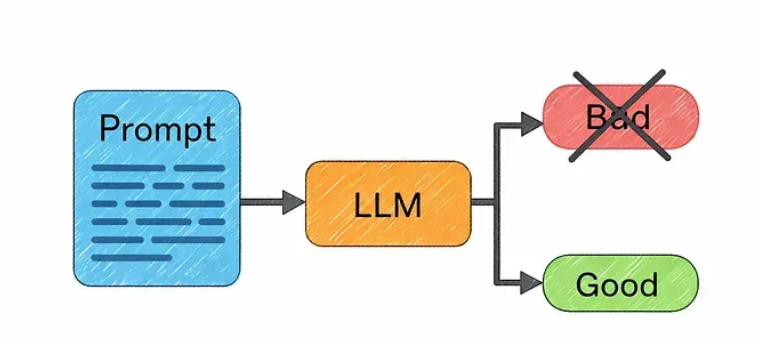

2、 RLHF (人类反馈强化学习)

如果没有 RLHF,AI 模型可能只是一个会说话的怪胎。是 RLHF 让它变得有礼貌、好用、且符合人类价值观。我们让模型生成几个回答,让人类来打分。 久而久之,模型学会了“人类喜欢听什么”,从而不再只是预测词语,而是在对齐人类的需求。数智化转型网www.szhzxw.cn

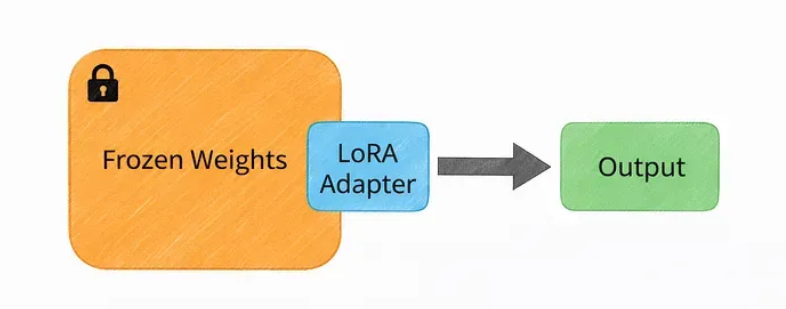

3、 LoRA (低秩自适应)

微调太贵了,怎么办?LoRA 是平民开发者的救星。它把庞大的模型“冻结”,只在旁边加一点点可训练的小插件。 这让曾经需要一个机房才能干的活,现在一张显卡就能搞定。它用最轻量的成本,换取了最高效的定制化。

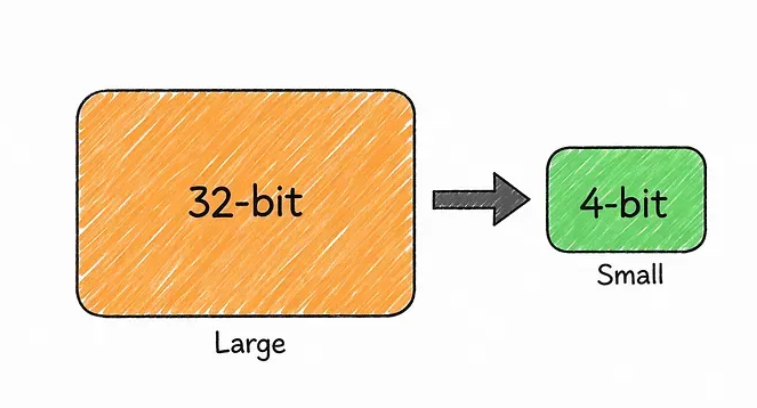

4、量化 (Quantization)

大模型太胖了,挤不进普通电脑。量化就是给模型“脱水”。通过降低数字的精度,模型体积可以瞬间缩小几倍。 虽然精度会有一丁点损失,但它让普通笔记本跑大模型成为了可能。这就是为什么 AI 能够真正走进千家万户。数智化转型网www.szhzxw.cn

五、应用与推理

1、提示词工程 (Prompt Engineering)

在 AI 时代,提问的方式决定了答案的质量。一个模糊的指令只会得到平庸的废话。 你需要给它设定角色、提供示例、规定格式。 这不是奇技淫巧,这是你和 AI 沟通的唯一语言。

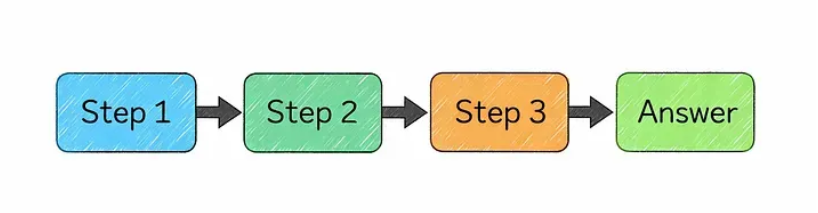

2、思维链 (Chain of Thought, CoT)

有时候 AI 答错,纯粹是因为它急着给答案,没过脑子。思维链就是让它把解题步骤写下来。一旦它开始“一步步思考”,它的逻辑和数学能力会发生质的飞跃。数智化转型网www.szhzxw.cn

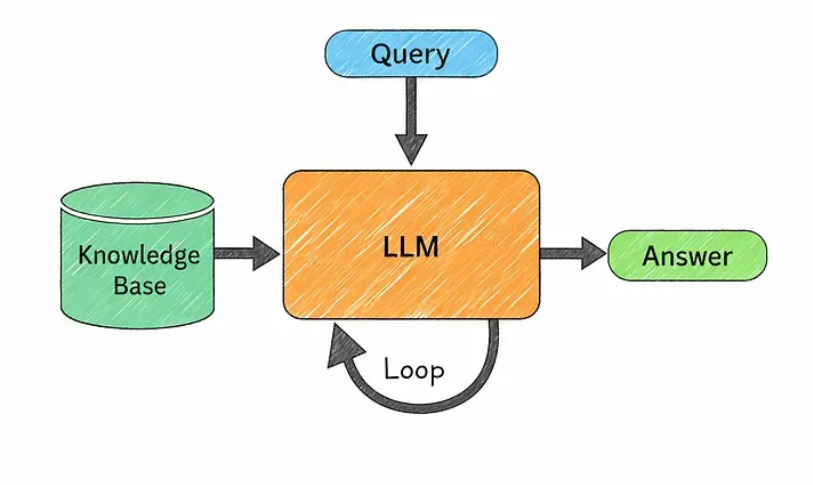

3、 RAG (检索增强生成)

这是对付幻觉最狠的招数。别让 AI 凭记忆背,让它翻书查。在回答前,系统先去数据库里找相关资料,再喂给 AI。 这样,AI 的回答就有了现实根据,而且你随时更新资料库,AI 就能掌握最新的信息,完全不需要重新训练。数智化转型网www.szhzxw.cn

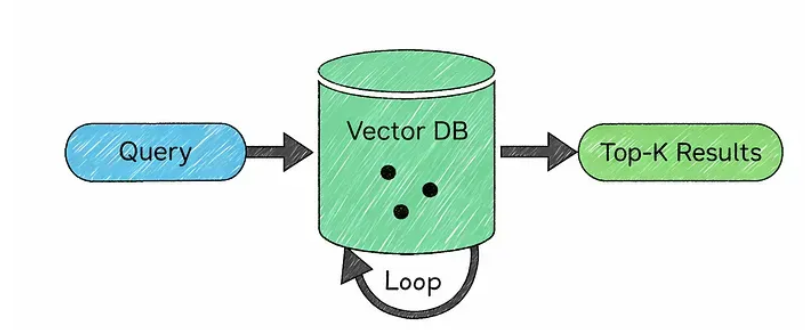

4、向量数据库 (Vector Database)

RAG 怎么精准找到资料?靠的就是向量数据库。它存的不是文字,是坐标。它能根据“意思”来搜,而不是死板的关键词匹配,这才是 AI 系统的“外挂大脑”。数智化转型网www.szhzxw.cn

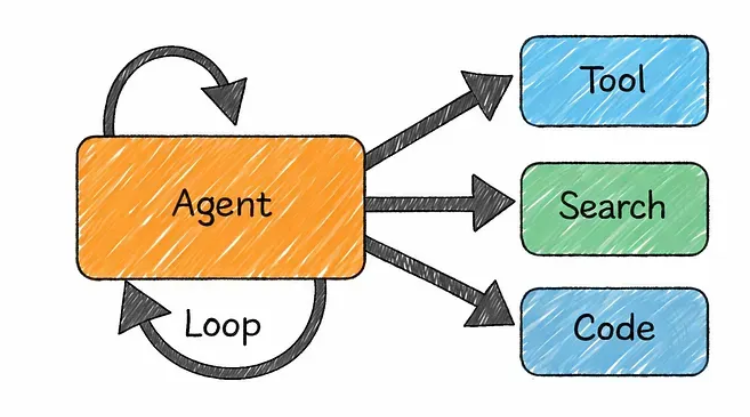

5、AI 智能体 (AI Agents)

这是 AI 的终极形态:不只动嘴,还要动手。Agent 会思考目标,拆解步骤,调用工具(查网页、跑代码、发邮件),直到完成任务,它从“问答机”变成了“执行者”。数智化转型网www.szhzxw.cn

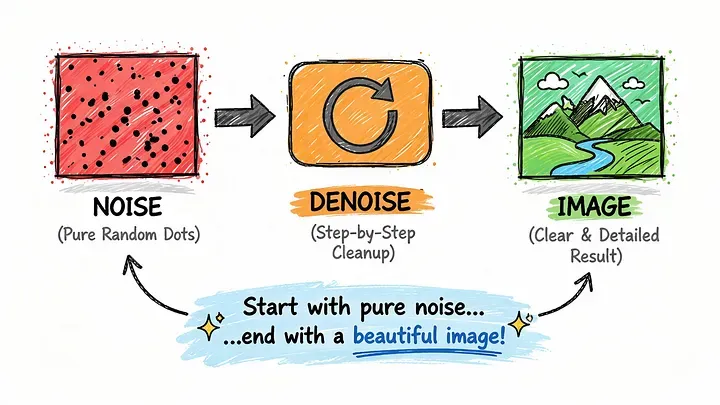

6、 扩散模型 (Diffusion Models)

这是绘图 AI 的心脏。它的原理很鬼才:先学会把照片揉成噪音,再学会把噪音变回照片。当你给它一段提示词,它就从一片虚无中,一点点拨开迷雾,画出你想要的奇迹。

若您对人工智能感兴趣,可添加数字化转型网小助手思思微信加入人工智能交流群。若您在寻找人工智能供应商,可联系数字化转型网小助手思思(17757154048,微信同号)数智化转型网www.szhzxw.cn

若您为人工智能服务商,可添加数字化转型网小助手Nora,加入人工智能行业交流群。

若您为人工智能创业者,可添加数字化转型网社群主理人Carina,加入人工智能创业交流群。

声明:本文来自网络,版权归作者所有。文章内容仅代表作者独立观点,不代表数字化转型网立场,转载目的在于传递更多信息。如有侵权,请联系我们。

本文由数智化转型网(www.szhzxw.cn)转载而成,来源于网络;编辑/翻译:数智化转型网(Professionalism Achieves Leadership 专业造就领导者)邵敏